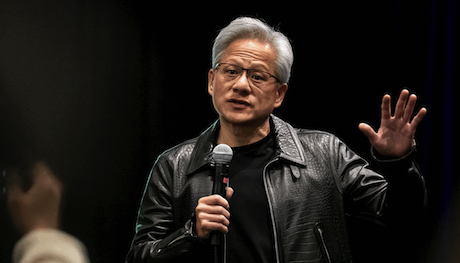

3月19日,英伟达CEO黄仁勋说了两句话。

第一句,如果到了2030年,AI新星Anthropic的年营收突破一万亿美元,一点都不奇怪。

第二句,科技圈的大佬们最好立刻停止贩卖AI恐慌,别再天天吓唬大众了。

这两句话连在一起看,其实揭示了目前科技界对于人工智能真正的态度博弈。

黄仁勋在一档播客讨论里指出,现在很多行业领袖在谈论AI风险时,尺度完全失控了。提醒大家注意技术风险当然是好事,但如果把合理的提示变成了无端的恐吓,那就有害无益了。

其实这就是个认知偏差的问题。在黄仁勋看来,现在的AI根本不是什么外星生物,也没有自我意识,它剥开神秘的外衣,本质上也就是一段计算机软件。这就好比汽车刚发明的时候,它确实有撞人的风险,但如果你天天在报纸上渲染汽车会像怪兽一样吃人,又拿不出任何科学证据,这种极端的言论带来的实质伤害,远比技术本身要大得多。

黄仁勋强调,对于国家层面而言,最大的AI风险根本不是技术失控,而是整个社会因为愤怒、恐惧或者偏执,主动放慢了应用AI的脚步。时代在狂飙,你因为害怕连车门都不敢进,这才是最致命的。

黄仁勋还力挺了开发了Claude大模型的Anthropic,Anthropic目前遇上了大麻烦,正因为AI安全问题在跟美国国防部在法庭上正面硬刚。

很多科技巨头为了拿政府订单,往往会妥协。但Anthropic的CEO是个死磕安全的倔骨头。他在跟军方谈合同的时候,死活要加上明确的限制条款:第一,我的AI产品绝对不能被用来监控本土老百姓。第二,绝对不能被用来开发全自动的致命武器。

这种强硬的底线要求,直接触怒了特朗普政府。结果就是,官方强硬出手,给Anthropic贴上了一个国家安全供应链风险的标签,正着手把他们从各个政府项目里剔除出去。双方现在是剑拔弩张。

但哪怕是在这样激烈的政治和法律对峙中,作为Anthropic重要合作伙伴的黄仁勋,依然给出了最顶格的看好。他不仅认为眼前的纠纷不影响大局,还大胆预测Anthropic到了2030年,年营收能冲破1万亿美元的大关。他甚至觉得对方CEO对自己公司的预测都太保守了。

这个表态其实释放了一个非常强烈的信号,在硅谷真正的领军人物眼里,守住技术不作恶的底线,和去追求万亿级的商业价值,不仅不矛盾,反而是这家公司最大的护城河。